'틀릴 수 있는' 기술인 AI로 제품 만들기 - Ben Evans

월요일에 짧은 여행으로 인도에 갈 예정이어서 아주 오류가 많은 온라인 비자 신청 과정을 한 시간 동안 고군분투했습니다. 다 끝내고 나니, 어떤 절차가 필요한지 알게 되었기에 ChatGPT 4에게 물어보았습니다. 대부분의 포인트가 부분적으로나 완전히 틀렸습니다.

이것은 '불공정한' 테스트입니다. 이는 LLM(대형 언어 모델)을 '잘못' 사용하는 좋은 예입니다. LLM은 데이터베이스가 아닙니다. 이들은 질문에 대해 정확한 사실적 답변을 제공하는 것이 아니라 확률적 시스템입니다. 오늘날의 LLM은 이 질문에 대해 완전히 정확한 답변을 줄 수 없습니다. 답변이 맞을 수도 있지만, 그것을 보장할 수는 없습니다.

사람들(종종 암호화폐와 NFT와 비교하여)이 이러한 것들이 쓸모없다고 가정하는 경향이 있습니다. 이는 오해입니다. 생성 AI 모델을 유용하게 생각하는 방법은 이러한 모델이 그러한 질문에 대한 좋은 답변이 어떻게 보일지를 매우 잘 알려준다는 것입니다. '좋은 답변처럼 보이는 것'이 정확히 필요한 경우도 있고, '대충 맞는 것'이 '정확히 틀린 것'인 경우도 있습니다.

사실, 이 문제를 좀 더 밀고 나가면, 같은 프롬프트와 같은 출력이 왜 그것을 원했는지에 따라 좋은 결과가 될 수도, 나쁜 결과가 될 수도 있다고 말할 수 있습니다.

어쨌든, 이 경우에는 정확한 답변이 필요했고, ChatGPT는 잘못된 답변을 주었습니다. 이것은 LLM이 할 수 없는 것을 요청한 것이므로 불공정하다고도 말할 수 있지만, 여전히 의미 있는 테스트입니다. 그리고 ChatGPT는 틀렸습니다.

이 문제를 해결하는 두 가지 방법이 있습니다. 하나는 이것을 과학 문제로 취급하는 것입니다 - 초기 단계이며, 모델은 개선될 것입니다. 'RAG'와 '다중 에이전트'를 많이 언급할 수 있습니다. 모델은 확실히 개선될 것이지만, 얼마나 개선될까요? 기계 학습 과학자들이 이에 대해 논쟁하는 유튜브 영상을 몇 주 동안 시청할 수 있으며, 그들이 실제로는 잘 모른다는 것을 배울 수 있습니다. 사실, 이것은 'LLM이 AGI를 생성할 것인가?'라는 논쟁의 한 버전입니다. 왜냐하면 모든 질문에 완전히 올바르게 답할 수 있는 모델은 최소한 하나의 AGI 유형의 좋은 정의처럼 들리기 때문입니다 (다시 말하지만, 아무도 모릅니다).

하지만 다른 경로는 이것을 제품 문제로 취급하는 것입니다. 모델이 잘못된 것을 '옳게' 만들 수 없음을 전제로 한 유용한 대중 시장 제품을 어떻게 구축할까요?

AI 사람들의 전형적인 반응은 "잘못 다루고 있다"는 것입니다 - 1: 잘못된 종류의 질문을 했고 2: 잘못된 방식으로 질문했다는 것입니다. 저는 프롬프트 엔지니어링을 많이 해야 했습니다! 하지만 지난 50년간의 소비자 컴퓨팅의 메시지는 사용자가 명령 줄을 배우게 해서 채택을 앞당기지 않는다는 것입니다 - 사용자를 향해 다가가야 합니다.

저는 이것을 두 가지 제품 문제로 더 나눌 수 있다고 생각합니다.

한편으로, 스크린샷의 제품 디자인은 모델 자체가 본질적으로 불확실한데 확실성을 전달하고 있습니다. Google은 (대부분) 열 개의 파란색 링크를 제공하여 '이 중 하나일 가능성이 있다'고 전달하지만, 여기에서는 하나의 '정답'을 제공합니다. 이는 많은 사람들을 오도하며, 특히 텍스트 생성(실제 답변과 구별됨)이 거의 완벽하기 때문에 그렇습니다. 실제로 Deloitte의 이 흥미로운 설문조사에 따르면, 이러한 시스템을 사용한 후에 이러한 명백한 확실성에 더 쉽게 오도될 수 있다고 합니다.

그러나 문제의 다른 절반은 제품이 내가 무엇을 물어볼 수 있는지조차 알려주지 않는다는 것입니다. '나쁜' 쿼리(정확하게 답변하기 어려운 질문)를 했지만, 제품에서는 그것을 알려주지 않았습니다. 대신, 이 제품은 범용 도구로 제시됩니다. 제품이 모든 것에 답하려고 하면, 모델이 정확할 가능성을 낮추는 동시에 좋은 질문이 무엇인지 전달하기도 어렵습니다.

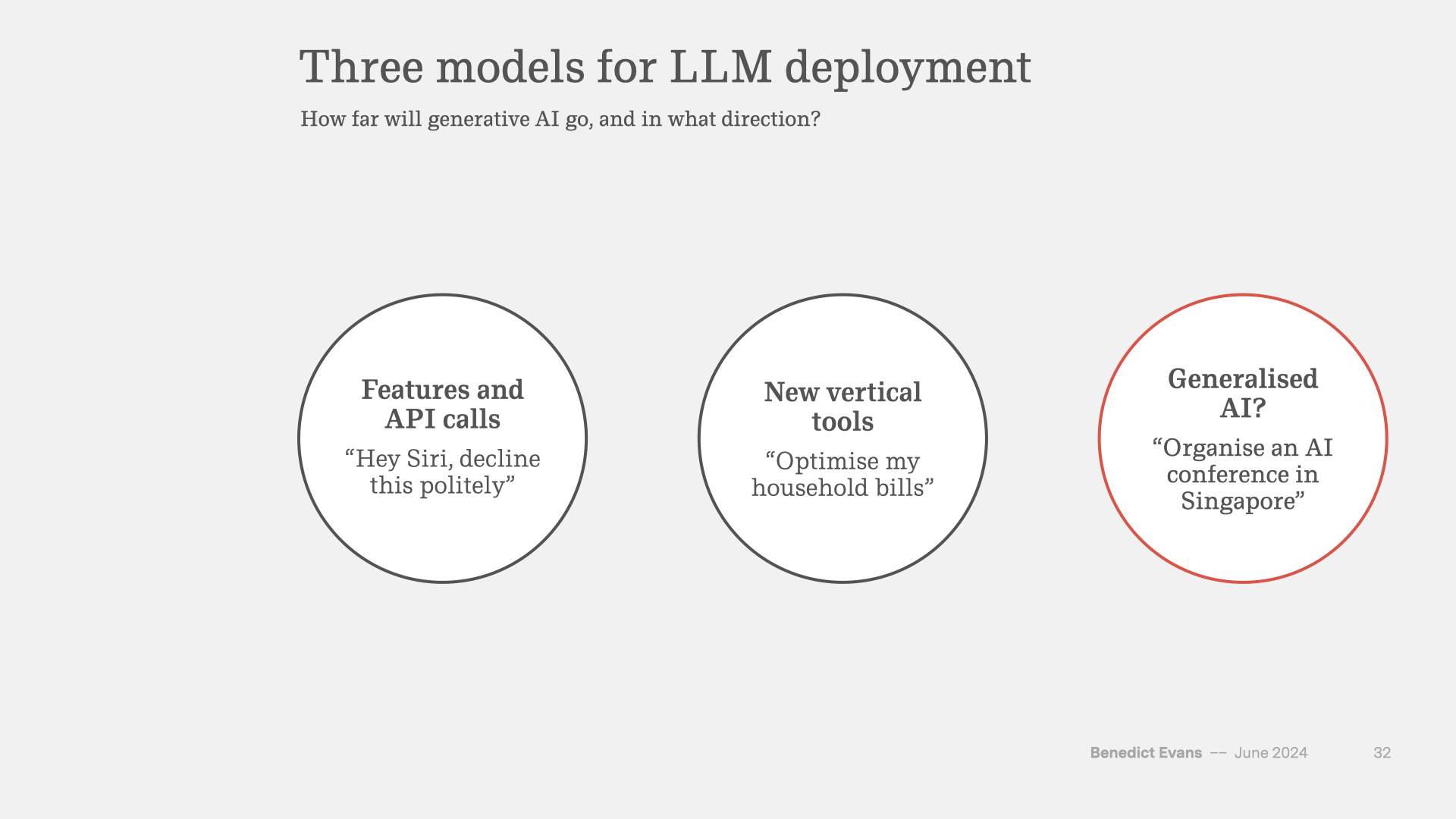

아래 슬라이드는 제가 인도에서 발표할 프레젠테이션을 위해 만들어진 것으로, 이에 의해 제안된 대안을 포착하려고 했습니다.

가장 급진적인 접근 방식은 제가 방금 논의한 범용 챗봇(Chatbot-as-product)입니다. 그러나 최소한 두 가지 다른 접근 방식도 있습니다.

첫 번째는 제품을 좁은 도메인에 제한하여 입력 및 출력 주위에 사용자 인터페이스(UI)를 만들어 무엇을 할 수 있고 할 수 없는지, 무엇을 물어볼 수 있는지를 전달하는 것입니다. 또한 모델 자체에 집중할 수도 있습니다(따라서 RAG). 이는 지난 12개월 동안 폭발적으로 증가한 코딩 어시스턴트 및 마케팅 도구와 지식 관리 도구의 첫 번째 시도를 제공합니다. WPP는 자사 직원이 특정 브랜드의 음성 톤이나 목표 인구 통계에 맞게 모델을 조정할 수 있는 내부 대시보드를 구축했습니다. 따라서 "이 도구에 브랜드 Y의 제품 X에 대한 50가지 아이디어를 제안하도록 요청하십시오 - 맹장염이 있는지 묻지 마십시오." 프롬프트를 제품 내에서 버튼과 UI로 감쌉니다.

하지만 다른 접근 방식은 사용자가 프롬프트나 출력을 보지 않거나, 이것이 생성 AI라는 것을 전혀 알지 못하며, 입력과 출력이 다른 것 내부의 기능으로 추상화되는 것입니다. 모델은 어떤 기능을 가능하게 하거나, 그 기능을 더 빨리, 더 쉽게 구축하게 합니다. 이것이 지난 기계 학습의 대부분이 소프트웨어로 흡수된 방식입니다: 새로운 기능이 있거나, 더 잘 작동하거나, 더 빠르고 저렴하게 구축할 수 있지만, 사용자는 그것이 'AI'인지 모릅니다 - 보라색도 아니고 작은 별들이 모여 있는 것도 아닙니다. 그래서 AI가 아직 작동하지 않는 것은 무엇이든 AI라고 하는 오래된 농담이 있습니다. 작동하면 그냥 소프트웨어일 뿐입니다.

이것을 다른 축에서 보면: 새로운 기술이 나올 때, 우리는 기존 문제에 맞추려고 시도하며, 기존 업체들은 그것을 기능으로 만듭니다(따라서 Google과 Microsoft가 지난 해 동안 자사 제품에 LLM을 뿌리고 있습니다). 그런 다음 스타트업들은 기존 업체를 분리(검색, Oracle, 이메일을 언번들)하려 하지만, 다른 스타트업들은 이 새로운 기술에 진정으로 맞는 것을 만들기 위해 무엇을 구축할 수 있을지 고민합니다. 이는 단계별로 이루어집니다. 처음에는 Flickr가 아이폰 앱을 가졌지만, 그 후 Instagram은 스마트폰 카메라를 사용하고, 로컬 컴퓨팅을 사용하여 필터를 추가했으며, Snap과 TikTok은 터치스크린, 비디오 및 위치를 사용하여 플랫폼에 진정으로 맞는 것을 만들었습니다. 그렇다면 이 새로운 기능을 추상화하여 챗봇 자체가 아니거나, '오류율'이 중요하지 않은 본질적인 경험을 무엇을 만들 수 있을까요?

물론 이것은 제가 전에 언급한 역설을 제안합니다: 여기에는 범용 기술이 있지만, 이를 배포하는 방법은 단일 목적의 도구와 경험으로 분리하는 것입니다. 그러나 이것을 역설로 보는 것은 올바른 추상화 수준을 잘못 놓는 것일 수 있습니다. 전동기는 범용 기술이지만, Home Depot에서 전동기 상자를 구매하지 않고, 드릴, 세탁기 및 믹서를 구매합니다. 범용 기술은 사용 사례로 구현됩니다. PC와 스마트폰은 단일 목적의 도구를 대체한 범용 도구입니다 - 타자기, 계산기, 음성 기록기 및 음악 플레이어를 대체했습니다 - 그러나 이러한 기능 각각은 단일 목적의 소프트웨어를 통해 달성됩니다: 대부분의 사람들은 Excel을 워드 프로세서로 사용하지 않습니다. 일부 사람들이 LLM에 대해 매우 흥분하는 이유 중 하나는 그들이 그 패턴을 따르지 않을 수도 있기 때문입니다: 모든 추상화 수준을 거쳐 최상위로 이동할 수 있습니다. 그것은 '얇은 GPT 래퍼'의 여지를 남기지 않습니다. 하지만 저는 그들이 아직 그렇게 할 수 없다고 생각하며, 그래서 제가 방금 쓴 모든 것은 그것이 결코 일어나지 않더라도 세상을 변화시키기 위해 무엇을 구축할 수 있는지에 대해 궁금해하는 것뿐입니다.

Comments ()